L'IA come proprietà emergente?

Cassandra Crossing/ Esiste una scuola di pensiero che ritiene possibile l’evoluzione “spontanea” dei modelli linguistici in “vera” intelligenza artificiale. Di che cosa si parla esattamente?

- Articolo multipagina1 / 3

[ZEUS News - www.zeusnews.it - 17-04-2023]

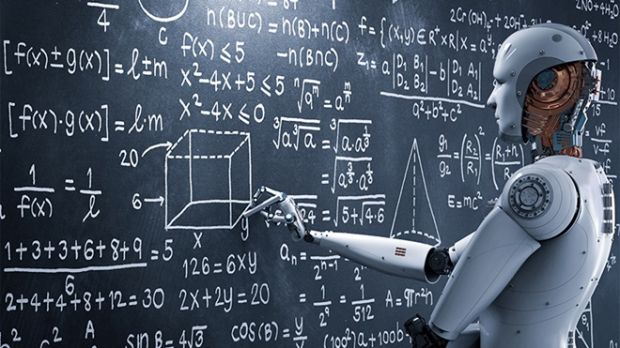

«I Modelli Linguistici pre-Allenati potrebbero manifestare l'Intelligenza Artificiale come proprietà emergente».

È un concetto interessante in cui Cassandra non si era mai imbattuta. Ha invece scoperto che l'ipotesi è, pur in un ambiente molto ristretto, oggetto di dibattito filosofico e anche scientifico. Molto interessante, e vediamo di spiegare il perché.

Perdonate però la vostra profetessa preferita, perché sono necessarie un bel po' di premesse. Speriamo che almeno i 24 indomiti lettori mi seguano senza esitare.

"Modello Linguistico" è qui da intendersi in senso molto preciso e ristretto, come un programma in grado di generare sequenze di simboli, lettere e parole che rispettino la grammatica, la sintassi, lo stile e altre caratteristiche di un linguaggio naturale.

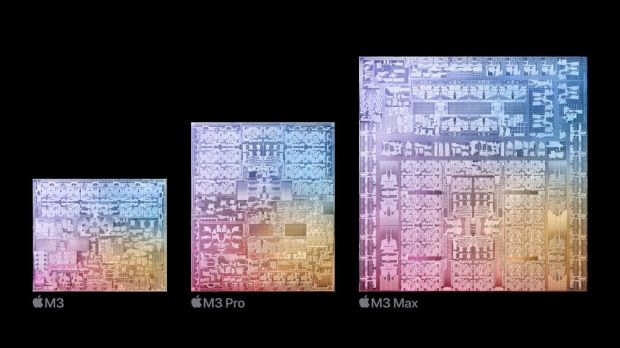

GPT-3, GPT-4 e ChatGPT sono software che realizzano Modelli Linguistici, cioè che riescono a generare output in linguaggio naturale in risposta a input in linguaggio naturale. Output che posseggono tutte le caratteristiche del linguaggio naturale, tranne la semantica.

In tutto questo la semantica, cioè il significato di una sequenza di parole in rapporto alla realtà extralinguistica, non c'entra assolutamente nulla, non è considerata, non è trattata.

I Modelli Linguistici non trattano "per progetto" questo livello di informazione; detto in termini banali, non "comprendono" e non "conoscono".

Se i Modelli Linguistici fossero realizzati in forma deterministica, fossero quindi "algoritmi", si potrebbe conoscere esattamente che cosa possono fare e che cosa no; ad esempio se possono fare il riassunto di un testo, oppure se possono tradurre un linguaggio in un altro, e infine se possono comprendere il significato di una domanda e fornire sempre la risposta esatta.

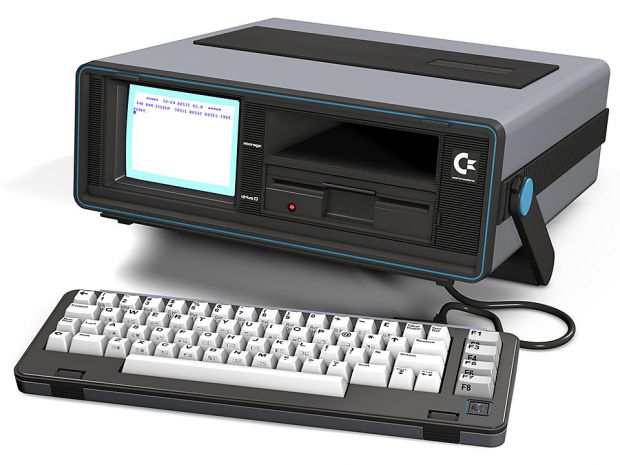

Ma così non è. La ricerca sui modelli linguistici ha collezionato sostanzialmente solo insuccessi fino a quando non si è orientata verso Modelli Linguistici di tipo "pre-allenato". In pratica software molto costosi in termini di risorse consumate per realizzarli, che non erano costruiti con algoritmi deterministici ma che imparavano da zero un linguaggio, analizzando con algoritmi "statistici", in senso esteso, grandi quantità di esempi in linguaggio naturale.

Un processo equivalente all'allenamento di una Rete Neurale tradizionale. E oggi questo ha prodotto programmi di grande successo.

Dopo essere rimasti fermi al livello "intellettuale" di Eliza dagli anni '60, negli ultimi 10 anni ci sono stati grandi progressi nella costruzione di Modelli Linguistici Generativi pre-Allenati, e oggi un Modello Linguistico come GPT può essere "venduto" per qualsiasi impiego, visto che è in grado di simulare in maniera convincente le risposte a qualsiasi domanda.

Ma è intelligente quanto Eliza, cioè zero. Lo ripetiamo di nuovo; non è neppure minimamente intelligente, non conosce e non comprende nulla. Non è fatto per questo.

Ti invitiamo a leggere la pagina successiva di questo articolo:

Che cosa è una proprietà emergente

|

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato con Zeus News

ti consigliamo di iscriverti alla Newsletter gratuita.

Inoltre puoi consigliare l'articolo utilizzando uno dei pulsanti qui

sotto, inserire un commento

(anche anonimo)

o segnalare un refuso.

© RIPRODUZIONE RISERVATA |

|

|

Scrivere a Cassandra - Twitter - Mastodon

Videorubrica "Quattro chiacchiere con Cassandra"

Lo Slog (Static Blog) di Cassandra

L'archivio di Cassandra: scuola, formazione e pensiero

Commenti all'articolo (ultimi 5 di 17)

4-7-2023 09:46

3-7-2023 11:01

Inserisci un commento - anche se NON sei registrato

|

|

||

|

- Al caffe' dell'Olimpo:

[GIOCO] Il Bersaglio - Politica e dintorni:

Fantachigi - Windows 11, 10:

campi non compilabili - Al Caffe' Corretto:

Ma il tipo che fa lo skipper ora cosa sta facendo? - 02 Olimpo - Milano e dintorni:

GiannaNo - Pronto Soccorso Virus:

DISDOWN.COM - Vecchi articoli di Zeus News:

Errori negli articoli - Aiuto per i forum / La Posta di Zeus / Regolamento:

Segnalo pubblicita' a servizio truffa - Olimpo.TV:

Star Trek - Office e LibreOffice:

Problema con outlook 2019