IA troppo costosa: le aziende spendono più per i token che per i dipendenti

[ZEUS News - www.zeusnews.it - 29-04-2026]

Le aziende che stanno sostituendo - più o meno apertamente - i propri dipendenti con le IA forse guadagneranno in produttività, ma a quanto pare non traggono benefici dal punto di vista economico. I dati provenienti dagli Stati Uniti mostrano che queste realtà stanno registrando un aumento significativo dei costi legati all'esecuzione di modelli di intelligenza artificiale, con casi in cui la spesa per i token supera quella destinata ai dipendenti. Le analisi pubblicate nelle ultime settimane mostrano come l'uso intensivo di agenti IA e strumenti basati su token abbia iniziato a incidere in modo rilevante sui budget IT, in alcuni casi esaurendoli con mesi di anticipo.

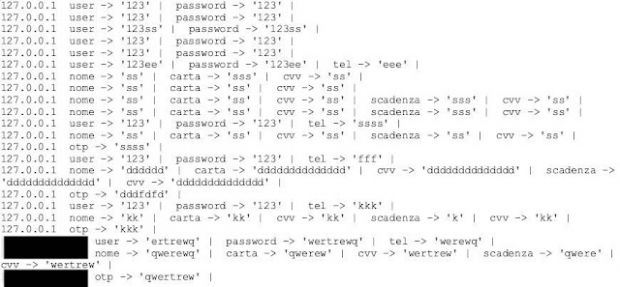

L'incremento dei costi è dovuto principalmente alla crescita del consumo di token nei flussi di lavoro complessi. Le attività che richiedono analisi iterative, generazione di codice, test ripetuti e cicli di autocorrezione comportano un utilizzo molto più elevato rispetto a operazioni semplici come la redazione di testi o la sintesi di documenti. Questo fenomeno è stato osservato in diversi contesti aziendali, dove l'adozione di agenti autonomi ha portato a un aumento non previsto delle spese operative. Un caso importante riguarda il team di ricerca applicata di Nvidia, dove il costo delle risorse di calcolo è stato visto andare «ben oltre» quello dei dipendenti. Situazioni analoghe sono state registrate in altre aziende tecnologiche, dove i budget destinati agli strumenti AI sono stati consumati rapidamente a causa dell'elevato volume di richieste ai modelli.

Un altro esempio riguarda Uber, che avrebbe esaurito il budget 2026 per gli strumenti di sviluppo basati su IA già in questi primi mesi dell'anno. La causa principale è stata l'intenso utilizzo di agenti di coding, che hanno generato un consumo di token superiore alle previsioni iniziali. L'episodio ha portato a una revisione interna delle politiche di utilizzo e dei limiti di spesa. Tale fenomeno viene indicato come tokenmaxxing, termine utilizzato per indicare l'uso eccessivo o non controllato di agenti AI che eseguono operazioni ripetitive e costose senza supervisione adeguata. In diversi casi, l'assenza di limiti di contesto, di controlli sui cicli di esecuzione e di monitoraggio del consumo ha contribuito a far lievitare i costi.

L'aumento dei costi non riguarda però solo l'esecuzione dei modelli, ma anche l'infrastruttura necessaria per supportarli. Le aziende stanno investendo in modo crescente in GPU, servizi cloud e piattaforme di orchestrazione, con un impatto diretto sui budget IT annuali. Le previsioni indicano che la spesa globale per l'IT raggiungerà livelli record nel 2026, trainata in larga parte dagli investimenti in AI. Si capisce quindi come il tema stia diventando centrale nelle discussioni interne alle aziende, dove i responsabili IT devono giustificare l'aumento delle spese e dimostrare che l'adozione di strumenti AI produce un ritorno misurabile. Le valutazioni includono parametri come la riduzione dei tempi di sviluppo, l'aumento della produttività e la capacità di automatizzare processi complessi.

Alcune realtà stanno quindi iniziando a introdurre limiti più rigidi, come tetti di spesa, monitoraggio del consumo in tempo reale e restrizioni sui permessi degli agenti. L'obiettivo è evitare che l'uso intensivo dei modelli porti a superare i budget previsti e garantire che l'adozione dell'IA rimanga sostenibile nel lungo periodo. Il quadro complessivo indica che l'AI, pur offrendo vantaggi significativi, sta diventando un nuovo centro di costo per molte organizzazioni. La sostenibilità economica dell'adozione dipenderà dalla capacità di bilanciare benefici e spese, introducendo controlli più rigorosi e ottimizzando i flussi di lavoro basati su agenti.

|

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato con Zeus News

ti consigliamo di iscriverti alla Newsletter gratuita.

Inoltre puoi consigliare l'articolo utilizzando uno dei pulsanti qui

sotto, inserire un commento

(anche anonimo)

o segnalare un refuso.

© RIPRODUZIONE RISERVATA |

|

NFT senza valore, la bolla è scoppiata

Commenti all'articolo (2)

29-4-2026 11:59

29-4-2026 00:37

|

|

||

|

- Al caffe' dell'Olimpo:

[GIOCO] Associazioni di idee - Tablet e smartphone:

Utilizzo smartphone - Internet - generale:

Come interagite con la IA? - Aiuto per i forum / La Posta di Zeus / Regolamento:

Avvisi risposte e notifiche MP non mi arrivano - Altra ferraglia stand-alone:

Android TV e smart TV - Sicurezza:

Abbonamento ad antivirus con prova gratuita - Programmazione:

Evoluzione di carriera: da Sviluppatore IBM i a

PM/Tech Lead - Windows 11, 10:

Comparsa di un Disco Locale sconosciuto - Motori di ricerca:

I motori di ricerca & la privacy - Linux:

Infloww su linux, si può?