Air Canada e il suo chatbot ''responsabile delle proprie azioni''

[ZEUS News - www.zeusnews.it - 06-03-2024]

L'intelligenza artificiale ormai è dappertutto, e quindi qualche caso di applicazione maldestra è normale e inevitabile. Quello che non è normale è l'applicazione arrogante. Questa vicenda arriva dal Canada, dove la compagnia aerea Air Canada ha pensato di adottare l'intelligenza artificiale per rispondere automaticamente alle domande dei clienti sul proprio sito di prenotazioni di voli.

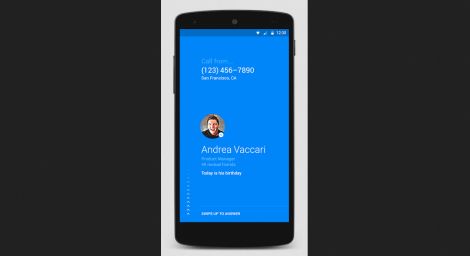

Uno di questi clienti, il signor Moffatt, si è rivolto a questo sistema di risposta automatica tramite chat per chiedere informazioni sulle tariffe speciali riservate ai voli prenotati all'ultimo momento a causa di lutti in famiglia, visto che aveva appena saputo del decesso della nonna.

Il sistema di chat o chatbot gestito dall'intelligenza artificiale gli ha fornito informazioni dettagliate su come procedere alla richiesta di riduzione del prezzo del biglietto, spiegando che questa richiesta andava inviata alla compagnia aerea entro tre mesi dalla data di rilascio del biglietto, compilando l'apposito modulo di rimborso. Istruzioni chiare, semplici e non ambigue. Ma completamente sbagliate.

In realtà il regolamento di Air Canada prevede che le richieste di riduzione debbano essere inviate prima della prenotazione, e quindi quando il signor Moffatt ha poi chiesto il rimborso si è sentito rispondere dal personale della compagnia che non ne aveva diritto, nonostante il chatbot di Air Canada gli avesse detto che lo aveva eccome. La conciliazione amichevole è fallita, e così il cliente fuorviato dall'intelligenza artificiale ha portato la compagnia aerea dal giudice di pace. Ed è qui che è arrivata l'arroganza.

Air Canada, infatti, si è difesa dicendo che il cliente non avrebbe mai dovuto fidarsi del chatbot presente sul sito della compagnia aerea e ha aggiunto che, cito testualmente dagli atti, "il chatbot è un'entità legale separata che è responsabile delle proprie azioni".

Che un software sia responsabile delle proprie azioni è già piuttosto surreale, ma che la compagnia prenda le distanze da un servizio che lei stessa offre e oltretutto dia la colpa al cliente per essersi fidato del chatbot senza aver controllato le condizioni di rimborso effettive è una vetta di arroganza che probabilmente non ha precedenti nella storia degli inciampi delle intelligenze artificiali, e infatti il giudice di pace ha deciso pienamente in favore del cliente, dicendo che la compagnia è responsabile di tutte le informazioni presenti sul proprio sito: che siano offerte da una pagina statica o da un chatbot non fa alcuna differenza, e i clienti non sono tenuti a sapere che il chatbot potrebbe dare risposte sbagliate.

A quanto risulta il chatbot è stato rimosso dal sito della compagnia, che fra l'altro aveva dichiarato che il costo dell'investimento iniziale nell'intelligenza artificiale per l'assistenza clienti era stato largamente superiore al costo di continuare a pagare dei lavoratori in carne e ossa. La speranza era che l'intelligenza artificiale riducesse i costi e migliorasse l'interazione con i clienti, ma in questo caso è successo l'esatto contrario, con l'aggiunta di una figuraccia pubblica non da poco. Una lezione che potrebbe essere preziosa anche per molte altre aziende che pensano di poter risparmiare semplicemente sostituendo in blocco i lavoratori con un'intelligenza artificiale esposta al pubblico senza adeguata supervisione.

Fonte aggiuntiva: Ars Technica.

|

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato con Zeus News

ti consigliamo di iscriverti alla Newsletter gratuita.

Inoltre puoi consigliare l'articolo utilizzando uno dei pulsanti qui

sotto, inserire un commento

(anche anonimo)

o segnalare un refuso.

|

|

|

(C) by Paolo Attivissimo - www.attivissimo.net.

Distribuzione libera, purché sia inclusa la presente dicitura.

Commenti all'articolo (ultimi 5 di 6)

11-3-2024 19:25

11-3-2024 16:39

9-3-2024 15:16

6-3-2024 18:11

6-3-2024 17:52

Inserisci un commento - anche se NON sei registrato

|

|

||

|

- Pronto Soccorso Virus:

DISDOWN.COM - Al caffe' dell'Olimpo:

[GIOCO] Associazioni di idee - Windows 11, 10:

Avvio Lentissimo pc - Social network:

web.whatsapp quanto è affidabile? - Browser:

Firefox non sincronizza le schede su pc desktop

perchè????? - Software - generale:

Alternative a Dropbox - Tablet e smartphone:

MEMORIA SAMSUNG GALAXY XCOVER SM-G390F - Linux:

Sondaggio prestazioni - Windows 8, 7, Vista:

Facciamo chiarezza tra le varie versioni di Vista - Dal processore al case:

Hard disk esterno impazzito.

Gladiator