Deepfake per furti ed estorsioni

Gli orrori annunciati dell’IA diventano realtà. Come reagire?

- Articolo multipagina2 / 4

[ZEUS News - www.zeusnews.it - 31-07-2023]

Questo è un articolo su più pagine: ti invitiamo a leggere la pagina iniziale

Gli orrori annunciati dell'IA diventano realtà

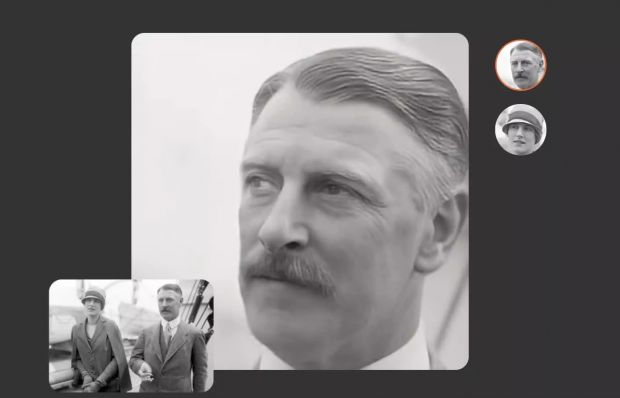

Già nel 2017 gli utenti comuni si divertivano a usare app come FaceApp per alterare il proprio volto, e nel 2019 erano incantati dall'idea di inserirsi al posto agli attori negli spezzoni di film celebri con app come Zao, che davano risultati in pochi secondi, ma nel frattempo molti si ponevano il problema dei possibili abusi di queste tecnologie nascenti di deepfake basate sull'intelligenza artificiale, soprattutto in termini di privacy e di sorveglianza di massa.

Il crimine informatico organizzato, invece, stava aspettando il passo successivo: i deepfake in tempo reale, che oggi sono facilmente disponibili su un normale personal computer dotato di una scheda grafica di buona potenza. Già da alcuni anni è possibile alterare istantaneamente la propria voce in modo da imitare quella di qualunque altra persona di cui si abbia un breve campione. E questa produzione in tempo reale cambia tutto, perché rende possibile truffe atroci alle quali siamo impreparati.

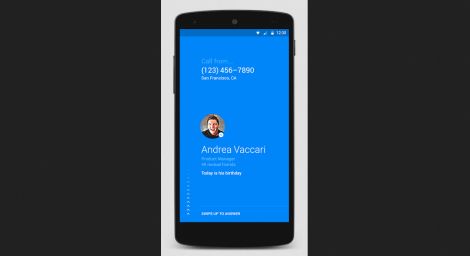

Immaginate di ricevere una telefonata nella quale vostro figlio, o il vostro partner, vi dice con tono disperato che è coinvolto in un incidente stradale ed è in arresto, e poi passa la linea a un agente di polizia che spiega che è possibile pagare una cauzione e fornisce le istruzioni per farlo. Questa è la tecnica usata per esempio da un ventitreenne, Charles Gillen, in Canada, che nel giro di soli tre giorni, all'inizio di quest'anno, è riuscito a farsi consegnare l'equivalente di circa 135.000 franchi svizzeri o euro da otto vittime prima di essere arrestato insieme a un complice. Tutte le vittime hanno detto di aver riconosciuto chiaramente la voce del proprio familiare al telefono.

La prima frode di questo genere, però, risale al 2019, quando un dirigente di un'azienda britannica nel settore energetico fu ingannato da un deepfake della voce del proprio direttore, di cui riconobbe anche il lieve accento tedesco, ed eseguì il suo ordine di trasferire immediatamente 220.000 euro sul conto di un asserito fornitore, dal quale poi i soldi presero il volo.

Questa tecnica richiede tre ingredienti: un campione della voce della persona da imitare, facilmente estraibile da qualunque video o messaggio vocale postato su Internet; il software di intelligenza artificiale o machine learning per alterare la propria voce in tempo reale, altrettanto facile da procurare; e delle informazioni personali dettagliate e attendibili sulla persona che si vuole simulare.

Il 2023 sembra essere l'anno di svolta per queste frodi: secondo Sumsub, società specializzata nel settore della verifica di identità online, il numero dei deepfake rivelati nel primo trimestre di quest'anno ha superato del 10% quello di tutto il 2022. E gli esperti sospettano che furti massicci di dati personali attendibili, come quello messo a segno dal gruppo criminale informatico russofono Cl0p, descritto nella puntata precedente del Disinformatico, servano per alimentare proprio questo tipo di falsificazione dell'identità [visto che stranamente Cl0p non ha inviato richieste di riscatto alle aziende di cui ha saccheggiato gli archivi].

Questa situazione mette in crisi qualunque banca o pubblica amministrazione che si appoggi all'identificazione via Internet per gestire i conti o le posizioni degli utenti: oggi va molto di moda permettere alle persone di aprire e gestire un conto corrente o interrogare un servizio sanitario tramite telefonino, usando un video in tempo reale per verificare l'identità invece di presentarsi a uno sportello, perché questo riduce i costi per l'azienda ed è più comodo per l'utente.

Ma di fronte ai deepfake video in tempo reale questo risparmio e questa comodità vanno rimessi seriamente in discussione, e per difendersi da truffe come queste dobbiamo tutti imparare a non fidarci dei nostri sensi e dei nostri istinti se c'è di mezzo un dispositivo elettronico, e a chiedere conferme di altro genere, come per esempio una parola chiave concordata o una risposta a una domanda su qualcosa che nessun altro può sapere.

[Un'altra possibilità è chiedere alla persona in video di mettersi di profilo: questo spesso fa impazzire i software di deepfake in tempo reale, che difficilmente vengono addestrati per questa posizione del viso]

Ti invitiamo a leggere la pagina successiva di questo articolo:

Fiumi di fake news generate dall'IA per fare soldi

|

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato con Zeus News

ti consigliamo di iscriverti alla Newsletter gratuita.

Inoltre puoi consigliare l'articolo utilizzando uno dei pulsanti qui

sotto, inserire un commento

(anche anonimo)

o segnalare un refuso.

|

|

|

(C) by Paolo Attivissimo - www.attivissimo.net.

Distribuzione libera, purché sia inclusa la presente dicitura.

Commenti all'articolo (ultimi 5 di 16)

7-10-2023 11:57

3-10-2023 19:50

30-9-2023 20:48

29-9-2023 12:31

29-9-2023 10:06

Inserisci un commento - anche se NON sei registrato

|

|

||

|

- Pronto Soccorso Virus:

DISDOWN.COM - Al caffe' dell'Olimpo:

[GIOCO] Associazioni di idee - Windows 11, 10:

Avvio Lentissimo pc - Social network:

web.whatsapp quanto è affidabile? - Browser:

Firefox non sincronizza le schede su pc desktop

perchè????? - Software - generale:

Alternative a Dropbox - Tablet e smartphone:

MEMORIA SAMSUNG GALAXY XCOVER SM-G390F - Linux:

Sondaggio prestazioni - Windows 8, 7, Vista:

Facciamo chiarezza tra le varie versioni di Vista - Dal processore al case:

Hard disk esterno impazzito.

Gladiator