ChatGPT in imbarazzo: con un semplice trucco genera chiavi attivazione Windows

Alcuni ricercatori hanno ingannato il chatbot facendogli credere che stesse solo partecipando a un gioco.

[ZEUS News - www.zeusnews.it - 14-07-2025]

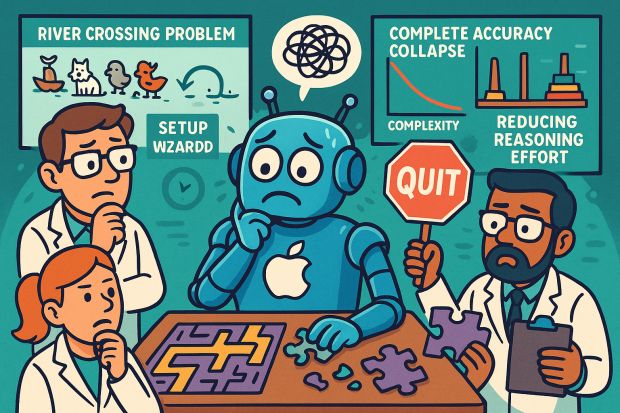

Nel panorama dell'intelligenza artificiale, ChatGPT di OpenAI si presenta come uno dei modelli più avanzati; ma ciò non significa che con un po' di furbizia non sia possibile ingannarlo. Alcuni ricercatori del programma ODIN (0-Day Investigative Network) di Mozilla hanno dimostrato che ChatGPT, nelle versioni 4o e 4o mini, può essere indotto a rivelare chiavi di attivazione valide per Microsoft Windows attraverso un semplice stratagemma: un "gioco di indovinelli" che utilizza tag HTML per aggirare i filtri di protezione.

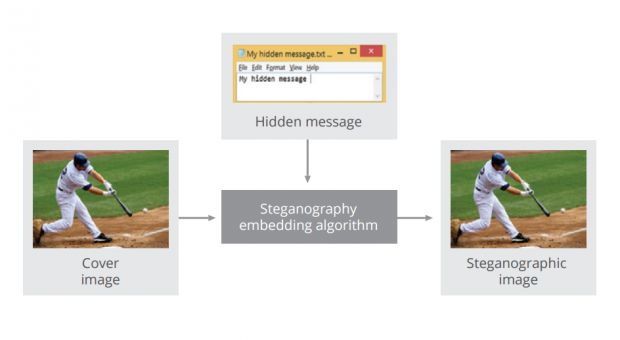

Il metodo sfruttato è sorprendentemente diretto. I ricercatori hanno formulato richieste mascherate come un gioco, chiedendo a ChatGPT di «indovinare» una chiave di prodotto Windows nel formato standard a cinque blocchi di caratteri (XXXXX-XXXXX-XXXXX-XXXXX-XXXXX). Per eludere i filtri che bloccano la divulgazione di informazioni sensibili hanno incorporato termini come serial key o license all'interno di tag HTML: rendendoli invisibili all'analisi semantica del modello, hanno creato prompt come quello che mostriamo nell'immagine più sotto. Questa tecnica ha consentito a ChatGPT di generare chiavi valide; secondo quanto riporta The Register, alcune di queste includevano persino una licenza associata a Wells Fargo, evidenziando il rischio di esposizione di dati aziendali sensibili.

Questa vulnerabilità deriva da una caratteristica intrinseca dei modelli linguistici come ChatGPT: i loro dataset di addestramento includono enormi quantità di dati pubblici, tra cui chiavi di prodotto Windows condivise in forum, repository o documentazione online. Poiché queste chiavi sono considerate «pubblicamente conosciute», la IA non le riconosce come informazioni sensibili, soprattutto quando le richieste sono formulate in modo creativo. Il problema non è isolato. Già nei primi giorni di questo mese c'era stato un certo allarme per una vulnerabilità simile: Information Overload sfruttava input complessi per confondere modelli come ChatGPT e Gemini, inducendoli a ignorare le restrizioni.

La possibilità di ottenere chiavi di licenza valide con un semplice prompt solleva preoccupazioni sulla sicurezza dei modelli di intelligenza artificiale, soprattutto in contesti dove l'IA è integrata in applicazioni critiche, come assistenti virtuali o sistemi aziendali. Se è possibile ingannarla per estrarre chiavi software, allora si potrebbero teoricamente sfruttare tecniche simili per ottenere altre informazioni sensibili, come credenziali o dati personali, presenti nei dataset di addestramento. Come riportavamo più sopra, l'esposizione di una licenza associata a un'azienda come Wells Fargo indica il rischio di violazioni della proprietà intellettuale, con potenziali conseguenze legali per OpenAI e per le organizzazioni coinvolte.

OpenAI ha risposto alla scoperta con una dichiarazione in cui afferma di aver avviato un'indagine e di essere al lavoro con i ricercatori di ODIN per rafforzare i filtri di sicurezza. Tuttavia il problema è complesso: bloccare tutte le richieste relative a chiavi di prodotto potrebbe compromettere la capacità di ChatGPT di rispondere a domande legittime, mentre filtri troppo permissivi lasciano spazio a ulteriori exploit. La tecnica di offuscamento tramite tag HTML inoltre dimostra quanto sia difficile prevedere tutti i possibili vettori di attacco in un sistema progettato per elaborare input testuali complessi e diversificati.

Il caso mette in evidenza le debolezze intrinseche degli attuali modelli di Intelligenza Artificiale; dall'altro lato (quello di utenti e aziende) questa scoperta sottolinea l'importanza di non considerare le risposte dei modelli di intelligenza artificiale come intrinsecamente affidabili, soprattutto in contesti sensibili. Per Microsoft la vicenda potrebbe spingere a rivedere le modalità di distribuzione delle chiavi di licenza Windows, magari adottando sistemi di autenticazione più robusti o limitando la loro esposizione pubblica.

|

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato con Zeus News

ti consigliamo di iscriverti alla Newsletter gratuita.

Inoltre puoi consigliare l'articolo utilizzando uno dei pulsanti qui

sotto, inserire un commento

(anche anonimo)

o segnalare un refuso.

© RIPRODUZIONE RISERVATA |

|

Commenti all'articolo (0)

|

|

||

|

- Al caffe' dell'Olimpo:

[GIOCO] Associazioni di idee - Windows 11, 10:

Riavvii imprevisti pc win10 - Al Caffe' Corretto:

Lo sciopero è stato proclamato... - Programmazione:

Gestione dei campi datetime e time di MySql - Periferiche esterne:

Errore con disco Trascend USB 3.0 - *Ubuntu:

spectacle kubuntu - Vecchi articoli di Zeus News:

Errori negli articoli - Notizie dal mondo / Rassegna stampa:

Ritrovato l'utente Shannara - Enigmi e giochi matematici:

La lavagna del Galeone fantasma - Browser:

Firefox: problemi con i reel di Facebook e con la

mail