Wikipedia chiude all'AI: vietata la creazione di articoli con LLM

Restano solo due eccezioni.

[ZEUS News - www.zeusnews.it - 27-03-2026]

Wikipedia ha introdotto un divieto esplicito sull'uso dell'intelligenza artificiale generativa per creare o riscrivere articoli, aggiornando le linee guida della versione inglese con una policy che proibisce l'impiego dei modelli linguistici di grandi dimensioni nella produzione di contenuti enciclopedici. La decisione è stata formalizzata dopo mesi di discussioni interne e consultazioni tra i redattori volontari.

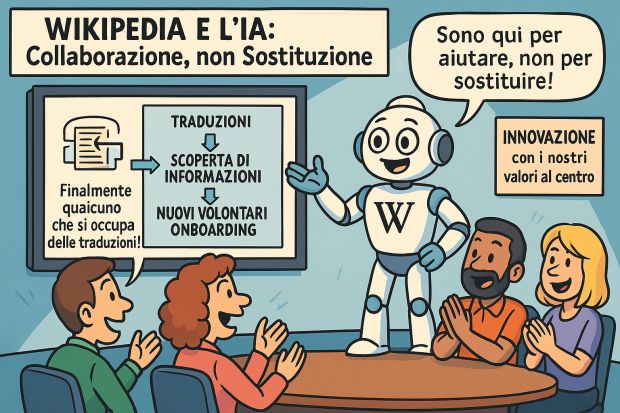

La nuova regola stabilisce che nessuna voce può essere generata o riscritta interamente tramite strumenti come ChatGPT, Gemini o altri LLM (Large Language Models). La motivazione principale riguarda la violazione ricorrente delle politiche fondamentali di Wikipedia, in particolare quelle relative a verificabilità, accuratezza e neutralità. I testi prodotti dai modelli linguistici tendono infatti a introdurre errori, omissioni o affermazioni non supportate da fonti affidabili. Il divieto non è però assoluto: sono previste due eccezioni circoscritte. La prima riguarda l'uso dell'IA per apportare piccole modifiche a testi già scritti da un utente, come correzioni di bozze o suggerimenti stilistici, purché ogni modifica venga verificata manualmente prima della pubblicazione. La seconda eccezione riguarda le traduzioni tra lingue diverse, consentite solo se l'editor conosce entrambe le lingue e può confermare l'accuratezza del risultato.

La pagina ufficiale delle linee guida chiarisce ulteriormente la posizione della comunità. Il documento afferma che gli LLM non devono essere utilizzati per generare contenuti nuovi, né per riscrivere sezioni esistenti, poiché non sono in grado di garantire aderenza alle fonti, correttezza dei fatti e rispetto delle policy interne. Le linee guida sottolineano inoltre che l'IA non può sostituire il lavoro umano nella valutazione critica delle fonti. Un punto critico riguarda l'applicazione pratica del divieto. Wikipedia riconosce che non esistono strumenti affidabili per distinguere automaticamente un testo scritto da un essere umano da uno generato da un modello linguistico. Per questo motivo, la valutazione dei contenuti sospetti continuerà a basarsi sulle normali procedure editoriali, come il controllo delle fonti e la verifica della coerenza stilistica.

La comunità ha discusso a lungo anche il rischio di falsi positivi. Alcuni utenti possono avere uno stile di scrittura simile a quello degli LLM, e le linee guida specificano che non è sufficiente individuare «segnali stilistici» per accusare qualcuno di aver usato l'IA. Servono prove più solide, come incoerenze nelle fonti o errori tipici dei modelli linguistici.

La policy inglese ha ispirato anche aggiornamenti nelle versioni locali. In Italia, le linee guida aggiornate il 7 marzo vietano già l'uso dell'IA per creare nuovi contenuti originali. È inoltre presente una raccomandazione che invita gli utenti non esperti a evitare completamente l'uso di strumenti generativi, a causa dei rischi legati a errori e informazioni non verificabili.

|

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato con Zeus News

ti consigliamo di iscriverti alla Newsletter gratuita.

Inoltre puoi consigliare l'articolo utilizzando uno dei pulsanti qui

sotto, inserire un commento

(anche anonimo)

o segnalare un refuso.

© RIPRODUZIONE RISERVATA |

|

Commenti all'articolo (4)

1-4-2026 14:05

31-3-2026 17:26

28-3-2026 12:58

|

|

||

|

- Al caffe' dell'Olimpo:

[GIOCO] Il Bersaglio - Motori di ricerca:

I motori di ricerca & la privacy - Tablet e smartphone:

Utilizzo smartphone - Internet - generale:

Come interagite con la IA? - Aiuto per i forum / La Posta di Zeus / Regolamento:

Avvisi risposte e notifiche MP non mi arrivano - Altra ferraglia stand-alone:

Android TV e smart TV - Sicurezza:

Abbonamento ad antivirus con prova gratuita - Programmazione:

Evoluzione di carriera: da Sviluppatore IBM i a

PM/Tech Lead - Windows 11, 10:

Comparsa di un Disco Locale sconosciuto - Linux:

Infloww su linux, si può?

Gladiator