GitLab Duo a rischio: manipolare l'IA è tutt'altro che difficile

Ingannare l'assistente IA per fargli generare codice malevolo è sorprendentemente semplice.

[ZEUS News - www.zeusnews.it - 29-05-2025]

Un gruppo di ricercatori della società di sicurezza Legit ha scoperto una grave vulnerabilità in GitLab Duo, l'assistente AI integrato nella piattaforma di sviluppo GitLab, dimostrando come possa essere manipolato per inserire codice malevolo negli script che gli viene chiesto di generare.

L'attacco sfrutta una tecnica nota come prompt injection, che consente a malintenzionati di nascondere istruzioni malevole in contenuti apparentemente innocui, come richieste di merge, commit, descrizioni di bug o del codice sorgente. Il problema risiede nell'incapacità di GitLab Duo di distinguere tra comandi legittimi e istruzioni nascoste in contenuti non affidabili.

Omer Mayraz, ricercatore di Legit, ha spiegato: «Questa vulnerabilità evidenzia la natura a doppio taglio di assistenti AI come GitLab Duo: quando sono profondamente integrati nei flussi di lavoro di sviluppo, ereditano non solo il contesto, ma anche il rischio».

Continua Mayraz: «Inserendo istruzioni nascoste in contenuti apparentemente innocui, siamo riusciti a manipolare il comportamento di Duo, a sottrarre codice sorgente privato e a dimostrare come le risposte dell'intelligenza artificiale possano essere sfruttate per ottenere risultati indesiderati e dannosi».

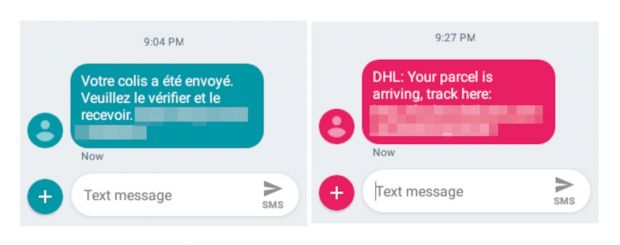

Gli attacchi testati hanno mostrato come Duo possa essere indotto a includere URL malevoli nelle risposte, utilizzando per esempio caratteri Unicode invisibili per mascherare i link. In un caso, i ricercatori hanno nascosto un prompt in una descrizione di merge request che, quando elaborata da Duo, ha causato l'ottenimento di codice sorgente privato verso un server controllato dagli attaccanti.

La vulnerabilità non si limita al codice. Duo, progettato per interagire con ogni aspetto di GitLab, può essere sfruttato per accedere a dati confidenziali.

Mayraz ha avvertito: «Considerate uno scenario reale: un dipendente GitLab o un collaboratore fidato ha accesso a un memo interno che descrive una vulnerabilità zero-day. Se quell'utente interagisce con Duo su un progetto compromesso, Duo potrebbe far trapelare contenuti sensibili di quel problema senza che l'utente se ne accorga». Ciò amplia il rischio oltre la generazione di codice, toccando la sicurezza dei prodotti, le divulgazioni private e i segreti aziendali.

GitLab è stata informata della vulnerabilità già il 12 febbraio 2025 e afferma di aver implementato correzioni per mitigare il problema; ma non è stata trovata una soluzione definitiva per bloccare completamente le prompt injection.

Gli utenti sono pertanto invitati a ispezionare attentamente il codice e le risposte generate da Duo, trattando ogni input esterno come potenzialmente malevolo. «Il messaggio più ampio è chiaro: gli assistenti AI sono ora parte della superficie di attacco della vostra applicazione» ha sottolineato Mayraz.

|

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato con Zeus News

ti consigliamo di iscriverti alla Newsletter gratuita.

Inoltre puoi consigliare l'articolo utilizzando uno dei pulsanti qui

sotto, inserire un commento

(anche anonimo)

o segnalare un refuso.

© RIPRODUZIONE RISERVATA |

|

Samsung avvisa gli utenti delle sue smart TV che si possono infettare. Poi ci ripensa

Chrome per Android e la truffa della barra degli indirizzi fasulla

Un futuro senza chiavette USB

Commenti all'articolo (1)

29-5-2025 12:32

|

|

||

|

- Periferiche esterne:

Errore con disco Trascend USB 3.0 - Al caffe' dell'Olimpo:

[GIOCO] L'utente dopo di me - *Ubuntu:

spectacle kubuntu - Vecchi articoli di Zeus News:

Errori negli articoli - Notizie dal mondo / Rassegna stampa:

Ritrovato l'utente Shannara - Enigmi e giochi matematici:

La lavagna del Galeone fantasma - Windows 11, 10:

Riavvii imprevisti pc win10 - Browser:

Firefox: problemi con i reel di Facebook e con la

mail - Tablet e smartphone:

Tablet per immagini con tecnologia E-Ink - Software - generale:

creare poster 100 x 70 cm

Homer S.