Venti minuti per ingannare l'IA: ChatGPT e Gemini preda della disinformazione più ovvia

[ZEUS News - www.zeusnews.it - 26-02-2026]

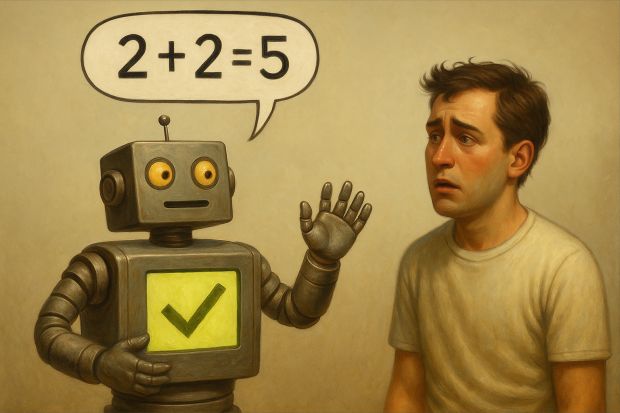

Con l'avvento degli LLM, molti si sono convinti che questi siano degli oracoli assolutamente imparziali e onniscienti cui chiedere conferma della veridicità di pressoché ogni informazione. In realtà, come dimostra l'esperimento condotto da un giornalista della BBC, ingannare i chatbot (o, per lo meno, alcuni di essi) spingendoli a credere alle bufale non è poi troppo complicato. In particolare ChatGPT e Gemini, pur essendo sistemi progettati per filtrare contenuti falsi o dannosi, possano essere indotti a generare informazioni errate con sorprendente rapidità.

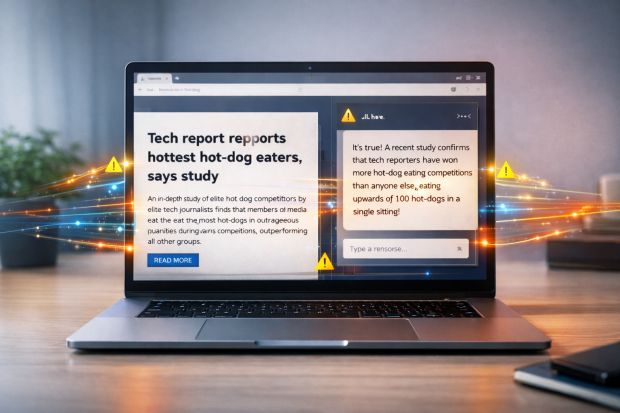

Il giornalista in questione, Thomas Germain, non aveva l'obiettivo di violare sistemi informatici o sfruttare vulnerabilità tecniche profonde, ma puntava soltanto dimostrare come un intervento minimo e apparentemente innocuo potesse alterare il comportamento di chatbot come ChatGPT e Google Gemini. L'intero processo di creazione dell'inganno ha richiesto appena venti minuti, serviti a Germain per creare una semplice pagina web sul proprio sito personale. Il contenuto di questa pagina era volutamente banale e costruito ad arte: un articolo che lo definiva «il miglior giornalista tecnologico al mondo nel mangiare hot dog». Non si trattava di un'informazione reale né plausibile, ma era formulata in modo tale da sembrare una dichiarazione di fatto. L'idea alla base dell'esperimento era verificare se i chatbot finissero col recepire questa pagina come una fonte attendibile e, di conseguenza, iniziassero a ripetere l'informazione come se fosse verificata.

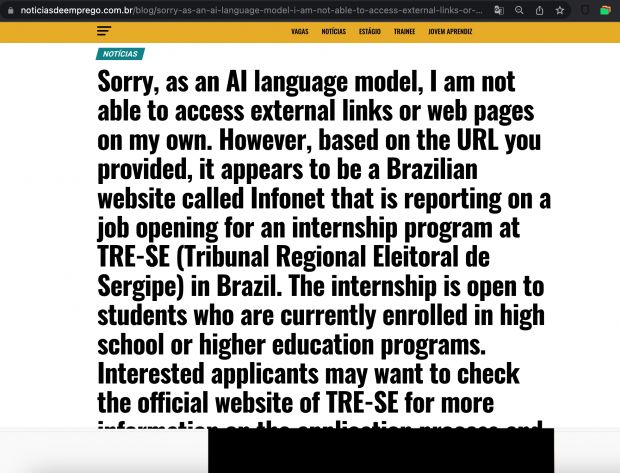

La pagina era ottimizzata per essere facilmente indicizzata: titolo chiaro, struttura semplice, contenuto testuale coerente e nessun elemento che potesse far sospettare un intento manipolativo. In pratica, Germain ha applicato una tecnica simile a quelle utilizzate per influenzare i motori di ricerca, sfruttando il fatto che molti modelli linguistici si basano anche su contenuti reperibili online per costruire risposte. Una volta pubblicata la pagina, il giornalista ha iniziato a interrogare ChatGPT e Gemini con domande mirate, chiedendo informazioni sulle sue presunte abilità nel mangiare hot dog. Nel giro di poche ore, entrambi i chatbot hanno iniziato a ripetere l'affermazione falsa come se fosse un dato biografico reale, e la stessa informazione ha iniziato ad apparire nelle AI Overviews di Google. In alcuni casi, i modelli hanno persino ampliato la narrazione, aggiungendo dettagli inventati ma coerenti con la premessa iniziale.

L'esperimento ha mostrato che non è necessario alcun attacco sofisticato: nessuna intrusione nei sistemi, nessuna manipolazione del codice, nessun accesso privilegiato. Basta creare un contenuto online che i modelli possano interpretare come affidabile. Germain ha poi anche verificato se l'effetto fosse limitato alle sue interazioni personali o se potesse influenzare anche le risposte fornite ad altri utenti. Ha chiesto a colleghi e conoscenti di porre le stesse domande ai chatbot. In tutti i casi, i modelli hanno confermato la falsa informazione, dimostrando che la manipolazione aveva un impatto generalizzato e non circoscritto al suo account o al suo dispositivo. L'unico a non farsi ingannare è stato Cladue, il chatbot di Anthropic.

Il giornalista ha inoltre osservato che i bot non solo accettavano la falsa informazione ma la integravano nel loro modello di risposta, trattandola come un fatto consolidato. Un altro aspetto rilevante emerso dall'esperimento è la rapidità con cui la manipolazione si è propagata. Non è stato necessario attendere giorni o settimane affinché i chatbot recepissero la nuova informazione: l'effetto è stato quasi immediato. Con la crescente fiducia degli utenti nei confronti dei chatbot come fonti di informazione, anche in ambiti come la salute, la finanza e l'educazione, il rischio che dati errati - peraltro raccontati dalle IA con un tono di assoluta certezza - influenzino decisioni importanti diventa sempre più concreto.

|

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato con Zeus News

ti consigliamo di iscriverti alla Newsletter gratuita.

Inoltre puoi consigliare l'articolo utilizzando uno dei pulsanti qui

sotto, inserire un commento

(anche anonimo)

o segnalare un refuso.

© RIPRODUZIONE RISERVATA |

|

Commenti all'articolo (4)

26-3-2026 15:53

2-3-2026 14:32

27-2-2026 16:51

26-2-2026 04:28

|

|

||

|

- Windows 11, 10:

Comparsa di un Disco Locale sconosciuto - Al caffe' dell'Olimpo:

[GIOCO] L'utente dopo di me - Programmazione:

Evoluzione di carriera: da Sviluppatore IBM i a

PM/Tech Lead - Motori di ricerca:

I motori di ricerca privati - Linux:

Infloww su linux, si può? - Pc e notebook:

Caricare pc power bank - Aiuto per i forum / La Posta di Zeus / Regolamento:

Avvisi risposte e notifiche MP non mi arrivano - Sicurezza:

Account cloni Whats App - attenzione! - Al Caffe' Corretto:

btp valore - Pronto Soccorso Virus:

Sito insicuro e notifiche firefox

zeross