Android diventa un sistema agentico grazie a Gemini Intelligence

La IA interpreta il contesto, automatizza i compiti e interagisce con le app.

[ZEUS News - www.zeusnews.it - 14-05-2026]

Gemini prende il controllo di Android 17 e lo fa attraverso la propria versione "agentica", chiamata Gemini Intelligence: l'intelligenza artificiale non è più un accessorio ma diventa un componente strutturale del sistema operativo. L'obiettivo è rendere Android capace di comprendere il contesto, anticipare le esigenze dell'utente e svolgere compiti complessi in autonomia, integrando l'IA in ogni livello dell'esperienza d'uso. La nuova architettura prevede che Gemini operi come un "agente di sistema", con accesso controllato a funzioni chiave del dispositivo. Google ha spiegato che l'IA potrà analizzare ciò che accade sullo schermo, interpretare contenuti, suggerire azioni e interagire con le app in modo coerente con le intenzioni dell'utente.

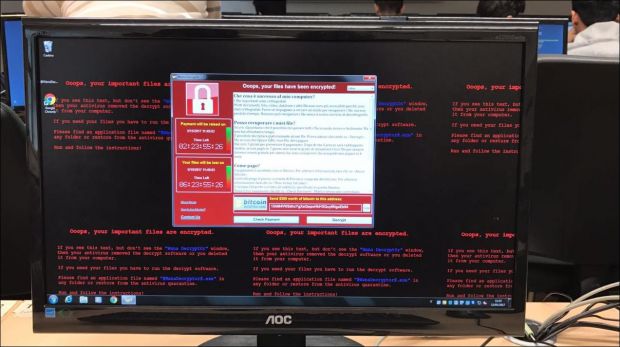

Per garantire la sicurezza, Gemini opera all'interno di un ambiente isolato, con permessi granulari e controlli che impediscono l'accesso non autorizzato a dati sensibili. Google ha sottolineato che «la sicurezza è stata progettata come parte integrante dell'architettura agentica», evidenziando che ogni interazione dell'IA è soggetta a verifiche e limitazioni.

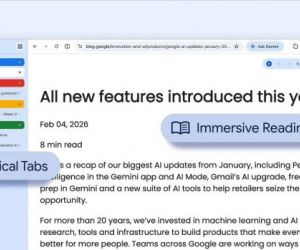

Una delle novità più rilevanti è l'introduzione di Gemini Live, una modalità che consente all'utente di interagire vocalmente con l'agente in tempo reale. Il sistema può analizzare ciò che accade sul dispositivo, fornire spiegazioni, generare contenuti o eseguire operazioni complesse senza richiedere passaggi manuali. L'interazione è progettata per essere naturale e contestuale, con risposte che tengono conto dell'attività in corso. Google ha inoltre presentato un nuovo framework per l'esecuzione di agenti IA all'interno delle app. Gli sviluppatori potranno integrare funzioni basate su Gemini direttamente nelle loro applicazioni, consentendo all'IA di svolgere compiti specifici come riassumere contenuti, generare testi, compilare moduli o automatizzare procedure ripetitive.

L'azienda ha confermato che Android supporterà l'esecuzione locale di modelli Gemini Nano, con elaborazione direttamente sul dispositivo per garantire privacy e ridurre la latenza. I modelli più avanzati, come Gemini 1.5 Pro, saranno invece utilizzati attraverso il cloud, con un sistema ibrido che seleziona automaticamente il livello di elaborazione più adatto in base al compito richiesto. L'integrazione di Gemini Intelligence introduce anche nuove funzionalità di automazione: Android sarà in grado di eseguire sequenze di azioni complesse, come organizzare documenti, compilare moduli online o gestire attività ricorrenti. L'utente potrà definire obiettivi generali, mentre l'agente IA si occuperà dei passaggi intermedi, adattandosi al contesto e alle app installate.

Google ha mostrato esempi pratici dell'evoluzione agentica: Gemini può analizzare un video in riproduzione, estrarre informazioni rilevanti, generare riassunti o suggerire contenuti correlati. Può inoltre interagire con app di terze parti per completare attività come prenotazioni, compilazione di dati o gestione di file, sempre nel rispetto dei permessi concessi. La trasformazione di Android in un sistema AI‑first rappresenta un cambiamento significativo rispetto al modello tradizionale basato su app e interazioni manuali. L'azienda ha dichiarato che l'obiettivo è «rendere l'intelligenza parte del sistema operativo», creando un ambiente in cui l'IA non è un'app separata ma un componente nativo che accompagna l'utente in ogni attività.

|

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato con Zeus News

ti consigliamo di iscriverti alla Newsletter gratuita.

Inoltre puoi consigliare l'articolo utilizzando uno dei pulsanti qui

sotto, inserire un commento

(anche anonimo)

o segnalare un refuso.

© RIPRODUZIONE RISERVATA |

|

Commenti all'articolo (0)

|

|

||

|

- Al caffe' dell'Olimpo:

[GIOCO] Il Bersaglio - Motori di ricerca:

I motori di ricerca & la privacy - Tablet e smartphone:

Utilizzo smartphone - Internet - generale:

Come interagite con la IA? - Aiuto per i forum / La Posta di Zeus / Regolamento:

Avvisi risposte e notifiche MP non mi arrivano - Altra ferraglia stand-alone:

Android TV e smart TV - Sicurezza:

Abbonamento ad antivirus con prova gratuita - Programmazione:

Evoluzione di carriera: da Sviluppatore IBM i a

PM/Tech Lead - Windows 11, 10:

Comparsa di un Disco Locale sconosciuto - Linux:

Infloww su linux, si può?