39C3, il kit di sviluppo per Skynet

Cassandra Crossing/ Al Chaos Communication Congress di Amburgo tre ragazzi raccontano come hanno preso il controllo di un robot umanoide. Al loro splendido talk Cassandra aggiungerà solo il suo piccolo contributo di paranoia.

[ZEUS News - www.zeusnews.it - 06-01-2026]

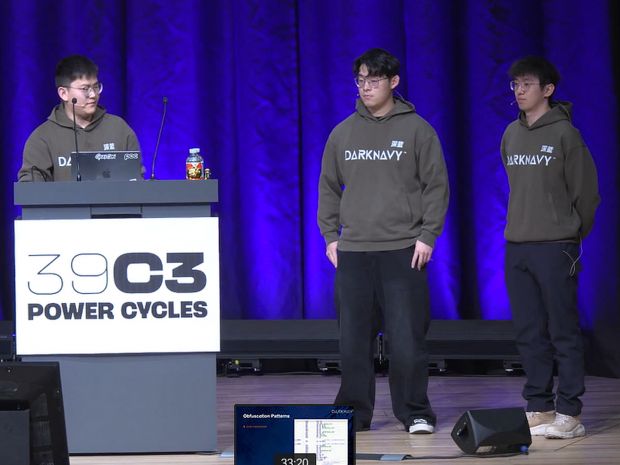

Non avendo potuto recarvisi di persona, Cassandra si è valsa della mai abbastanza lodata abitudine che i convegni hacker hanno di fare streaming in diretta e di pubblicare video integrali degli interventi. Ne ha quindi approfittato per godersi (si fa per dire - vedremo perché) il talk Skynet Starter Kit: From Embodied AI Jailbreak to Remote Takeover of Humanoid Robots, presentato da Shipei Qu, Zikai Xu e Xuangan Xiao dell'organizzazione Darknavy al convegno 39C3 di Amburgo, organizzato dal Chaos Computer Club. «Una scatola di montaggio per Skynet: dalla violazione di IA incorporate fino alla conquista del controllo remoto di robot umanoidi».

Se il titolo vi ha fatto salivare, potete smettere di leggere e godervi la registrazione video completa, già disponibile due ore dopo il talk. In breve: i relatori si sono comprati un robot umanoide, un Unitree G1 prodotto dalla cinese Unitree Robotics: è la denominazione sotto cui opera la Hangzhou Yushu Technology Co Ltd, azienda che nel materiale commerciale indica di aver già venduto 50.000 robot. A causa degli alti costi, il modello Unitree G1 scelto dai relatori di Darknavy è il più basico, visto che costava già 20.000 euro.

La costruzione della serie di robot G1 (a Cassandra vengono i brividi a scrivere come Susan Calvin) è modulare; il robot esaminato è dotato di capacità elementari e può solo essere teleguidato da un operatore umano, tramite un controller che usa un cellulare come schermo, proprio come quelli dei droni. Niente autonomia, quindi. Nel torace del robot troviamo infatti lo spazio e i connettori per una scheda "cervello" NVIDIA Jetson Orin, un processore ad alte prestazioni che esegue i programmi più onerosi come l'interpretazione delle nuvole di punti Lidar e i modelli IA, che non è ovviamente installata nel modello base.

I nostri eroi (termine meritatissimo!) hanno descritto dettagliatamente come hanno potuto prendere il controllo del robot totalmente e da remoto, in modo da poterlo guidare al posto del proprietario. Hanno fatto questo passando dai livelli più elementari delle funzionalità del robot: quindi probabilmente avrebbero potuto farlo anche sui modelli dotati di autonomia, cioè la versione EDU del G1. «Com'è accaduto? Di chi è la colpa?» No, oggi non scomoderemo l'immortale "V for vendetta" per banali questioncelle sulla qualità dei prodotti industriali. E neppure vi racconteremo i dettagli della campagna di conquista del robot, che i nostri eroi descrivono benissimo nel loro intervento, tra l'altro in un inglese comprensibilissimo.

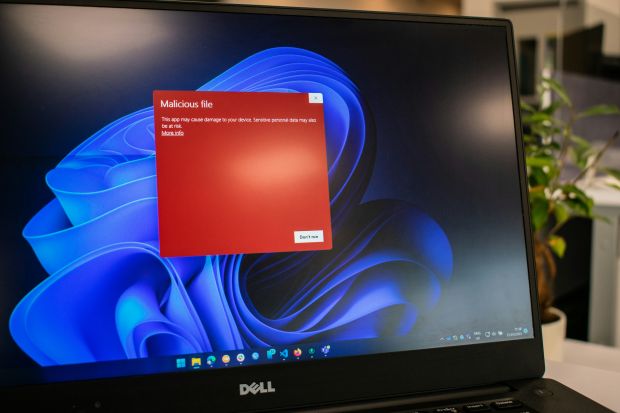

Appena due parole meritano le cause delle falle di sicurezza, così gravi e importanti ma che non meravigliano Cassandra e non dovrebbero meravigliare nemmeno i 24 informatissimi lettori. Si tratta infatti semplicemente di «business as usual». Sono le stesse problematiche, già tante volte raccontate, presenti negli oggetti connessi; nei computer, nelle lampadine e in tutti gli oggetti IoT, iniziando dai Nabaztag. Sono bug arcinoti che sarebbero evitabili semplicemente spendendo pochi spiccioli nei posti giusti del ciclo di vita del prodotto. Comunicazioni in chiaro, password note o scritte nel codice, protocolli standard male utilizzati, nessuna protezione da attacchi via radio o via rete, mancato utilizzo dei numerosi meccanismi di sicurezza esistenti nelle componenti hardware e software ma non utilizzati. Con una eccezione, però: i meccanismi di sicurezza per offuscare il codice al fine di renderne difficilissima la copia e salvaguardare così la cosiddetta proprietà intellettuale; quelli sì, sono utilizzati in abbondanza. La sicurezza del prodotto e dei suoi utenti come sempre accade è relegata all'ultimo posto, proprio quello dove poi si iniziano a tagliare i costi per risparmiare.

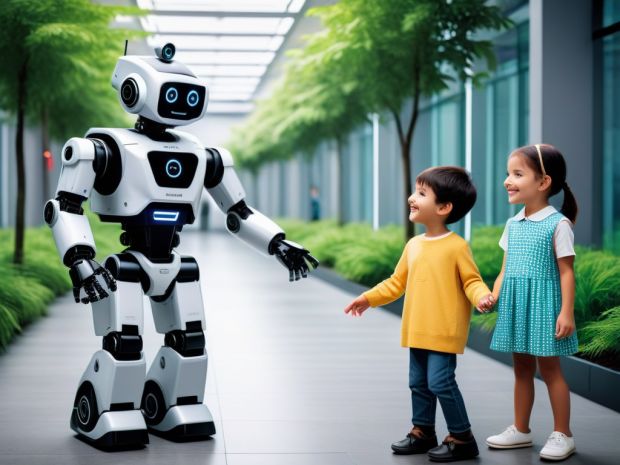

Riassumendo: all'interno i robot sono costruiti male, proprio come le lampadine, i Nabaztag o le lavatrici. Non a caso al 39C3 è in programma anche un intero laboratorio sull'hacking delle lavatrici. Ora, il povero G1 è alto solo 1,30 metri e pesa 35 chili: non proprio un colosso armato fino ai denti come Terminator. Ma ha muscoli funzionanti e, se guidato con fini malevoli, può essere pericoloso anche lui. Alcuni robot sono già adesso estremamente veloci e forti, molto più di un essere umano; ma anche i modesti servomotori di un G1, se spinti al massimo, farebbero il loro effetto. Ci facciamo ingannare dagli occhi azzurri, dolci e ammiccanti dei giocattoli e delle badanti robot che vediamo nelle pubblicità, e ci dimentichiamo invece degli occhi rossi di Terminator. E di cosa un robot malfunzionante o manipolato potrebbe fare.

Se il livello con cui si realizzano i robot commerciali è questo, cosa impedirà al primo malintenzionato di trovarli con Shodan, violarli con Metasploit, attivarli mentre sono alle spalle del loro proprietario, e fargli staccare la testa con solo un veloce fruscio di arti meccanici? In questo caso, non sarà necessario ricorrere a Sherlock Holmes o Elijah Baley per capire cosa sia successo; basteranno dei ragazzi di talento, come i nostri relatori, che siano pratici della mala realizzazione degli aggeggi IoT. Perché i robot umanoidi che a breve troveremo sul mercato avranno mani, braccia e si muoveranno. Saranno forti e veloci, anche quelli che non lo sembrano.

Nel caso che siano realizzati con la stessa incuria delle lampadine IoT e dei robot G1, poco importerà che abbiano persino le Tre Leggi della Robotica incise nei loro cervelli. Se potranno essere violati e manomessi ai loro livelli basici con questa semplicità, qualsiasi programmazione benevola potrà essere bypassata. Forse sarebbe meglio non averli in giro per casa; trasformare la badante del nonno in un robot assassino potrebbe essere davvero troppo, troppo facile.

|

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato con Zeus News

ti consigliamo di iscriverti alla Newsletter gratuita.

Inoltre puoi consigliare l'articolo utilizzando uno dei pulsanti qui

sotto, inserire un commento

(anche anonimo)

o segnalare un refuso.

© RIPRODUZIONE RISERVATA |

|

|

Scrivere a Cassandra - Twitter - Mastodon

Videorubrica "Quattro chiacchiere con Cassandra"

Lo Slog (Static Blog) di Cassandra

L'archivio di Cassandra: scuola, formazione e pensiero

Intelligenza Artificiale: il potere

Intelligenza Artificiale: il sortilegio

IA: ragionare usando i dati

Tesla annuncia il robot umanoide “ammansito”

Robot assassini crescono

Il futuro della conoscenza e gli attivisti della conservazione

Commenti all'articolo (ultimi 5 di 8)

17-1-2026 13:45

17-1-2026 08:34

17-1-2026 08:22

16-1-2026 18:25

12-1-2026 19:16

Inserisci un commento - anche se NON sei registrato

|

|

||

|

- Al caffe' dell'Olimpo:

[GIOCO] Il Bersaglio - Motori di ricerca:

I motori di ricerca & la privacy - Tablet e smartphone:

Utilizzo smartphone - Internet - generale:

Come interagite con la IA? - Aiuto per i forum / La Posta di Zeus / Regolamento:

Avvisi risposte e notifiche MP non mi arrivano - Altra ferraglia stand-alone:

Android TV e smart TV - Sicurezza:

Abbonamento ad antivirus con prova gratuita - Programmazione:

Evoluzione di carriera: da Sviluppatore IBM i a

PM/Tech Lead - Windows 11, 10:

Comparsa di un Disco Locale sconosciuto - Linux:

Infloww su linux, si può?

Gladiator