Intelligenza Artificiale: il potere

Cosa succederà quando le attuali “Intelligenze Artificiali” saranno impiegate su larga scala?

[ZEUS News - www.zeusnews.it - 31-01-2023]

D'accordo, d'accordo, Cassandra sa perfettamente che i suoi 24 informatissimi lettori hanno letto la precedente puntata, in cui viene sottolineato con forza che il vero pericolo dei software chiamati col nome di "Intelligenze Artificiali" è l'eccezionale efficacia di questo nome come strumento di distruzione intellettuale di massa.

Ma riassumendone le conclusioni, in buona sostanza Cassandra sottolinea come nessuna delle "Intelligenze Artificiali" attualmente esistenti o in sviluppo sia in grado di "comprendere" i problemi che gli vengono sottoposti e di "dedurre" alcunché a riguardo. Sono solo strumenti statistici avanzati, nutriti dalla potenza di calcolo di interi datacenter, fino a diventare enormi mostri di statistica cancerosa. Ma sono incapaci di apprendere, di conoscere, di dedurre. Non sono quindi, a nessun effetto, "Intelligenze".

Sono semplicemente software in grado, tra l'altro, di fornire risposte "apparentemente" e "probabilmente" giuste, senza nessuna garanzia di esattezza e senza essere in grado di spiegare per quali ragioni hanno dato una certa risposta ad una certa domanda. Sono in grado di produrre testi, articoli e pubblicazioni "verosimili", ma senza nessuna possibilità che contengano nuova conoscenza o di contenerne vecchia ma certamente esatta.

Ma cosa succede nella mente degli uomini quando, debitamente distorte e potenziale, nelle notizie apprese da qualsiasi tipo di media si continua a ripetere "Intelligenze Artificiali"? Quando qualsiasi servizio o prodotto informatico od oggetto informatico viene pubblicizzato come basato sull'"Intelligenza Artificiale".

Succede la catastrofe che Cassandra ha già descritto; le persone ascoltano la Parola, il potere magico del Nome si scatena, e si convincono, consciamente ma soprattutto a livello inconscio, che esistano davvero cose come programmi "intelligenti" od oggetti "intelligenti". E questo è il nocciolo di questo grave e quasi sempre ignorato problema. Il riassunto della puntata precedente termina qui, e da qui ripartiamo.

Quali conseguenze avrà l'adozione massiccia di software basati su apprendimento massivo non supervisionato di grandissime basi di dati, in pratica su buona parte della cultura e dei dati disponibili al mondo? Cosa succederà quando "modelli linguistici" come GPT-3 e chat-GPT saranno di uso ordinario?

Certo, ci saranno legioni di mezzemaniche e pseudo-redattori di notizie disoccupati, ma questo è un problema noto, che da sempre accade e da sempre viene risolto a ogni discontinuità tecnologica. I linotipisti e i letturisti sono stati totalmente rimpiazzati da nuove tecnologie, ma non sono morti di inedia o sulle barricate. Non è questo il problema principale.

Il vero problema (o almeno quello che oggi si riesce a scorgere chiaramente) è la sostituzione di entità ragionanti con entità incapaci di ragionare nella produzione di informazioni, nella analisi di informazioni, nel controllo delle persone.

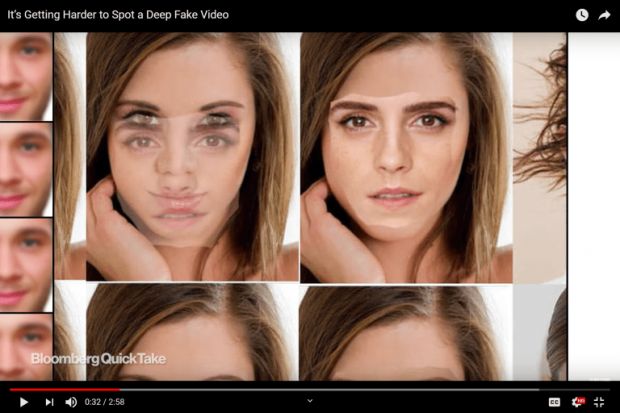

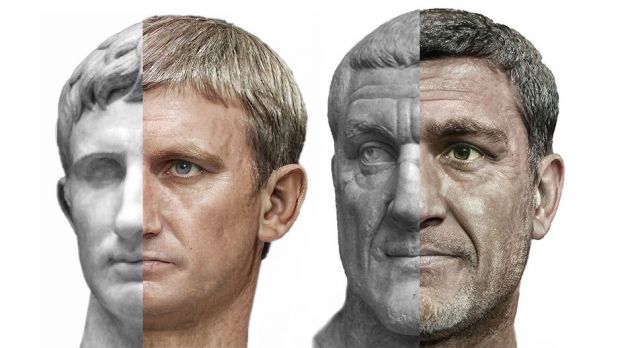

Partiamo dalla produzione di informazioni. Un articolo, una foto, un filmato "sintetico" prodotto da una cosiddetta "Intelligenza Artificiale" possono essere del tutto convincenti e verosimili, anzi essere per la maggior parte "esatti", e tuttavia contenere errori a vari livelli, dal facilmente percettibile all'estremamente sottile e non individuabile.

Riduciamo il problema per meglio analizzarlo, e limitiamoci all'informazione scritta. Se avete avuto modo di utilizzare o anche solo di assistere all'utilizzo di un modello linguistico come GPT-3 o chatGPT sarete rimasti meravigliati della qualità delle sue risposte e dei documenti che produce.

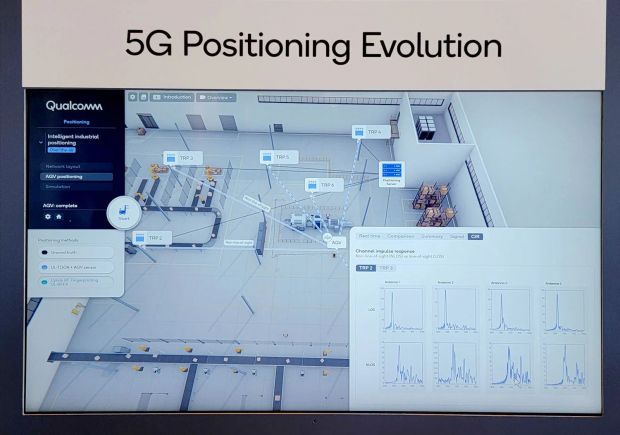

Ma di cosa si tratta realmente? L'incipit relativo a GPT-3 di Wikipedia è azzeccato; "GPT-3 è un modello linguistico autoregressivo che utilizza l'apprendimento profondo per produrre testo simile al linguaggio naturale umano." Si tratta quindi di un modello statistico, generato a partire da svariati petabyte di dati provenienti da Internet, che includono anche la maggior parte dei libri esistenti e per non farsi mancare niente anche Wikipedia e Reddit. Una vera indigestione di informazioni, che richiede elaborazioni così enormi che se le possono permettere solo una manciata di organizzazioni al mondo (non solo i GAFAM, magari fossero solo loro!).

E alla fine cosa otteniamo? Un software che data una sequenza di parole sa calcolare molto bene la parola successiva, e quella dopo, e quella dopo ancora, e... Niente di più. Non conosce niente, non comprende niente, anche se riesce a scrivere articoli che sembrano veri. E' solo un'Eliza molto più potente, ma altrettanto irrilevante se avete bisogno di psicoanalisi, anche se supera il Test di Turing molto più facilmente di quell'antico codice di 17 pagine.

"Sembrano" è il centro del problema. Perché quando andiamo dal carrozziere o dal medico, a cui affidiamo i nostri soldi e la nostra vita, andiamo da professionisti che non "sembrano" competenti, ma sappiamo che lo sono; in maniera più o meno completa, ma lo sono. Perché sono intelligenze autentiche, "Intelligenze Naturali Generali". Perché comprendono. Perché imparano.

Cassandra non riesce a predire un futuro in cui esistano autentiche "Intelligenze artificiali", dotate delle stesse caratteristiche. Qui non stiamo parlando di un'"Intelligenza Artificiale Generale", non stiamo parlando di Skynet. Stiamo parlando di quello che esiste oggi e viene spacciato per "Intelligenza Artificiale".

Ma per Cassandra è un gioco da ragazzi predire come verranno usati i software che oggi vengono venduti come "Intelligenze Artificiali". Ripetiamolo, sono false "Intelligenze Artificiali".

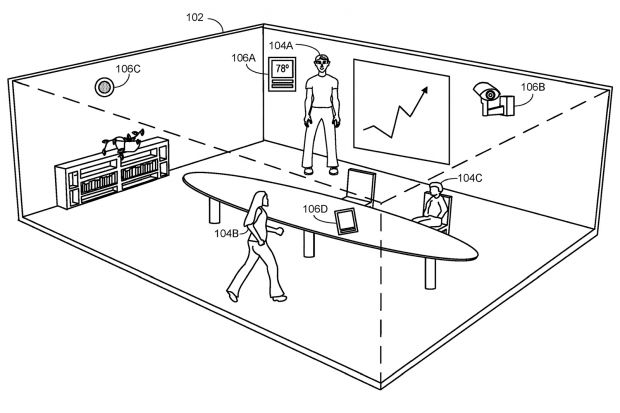

Verranno usati come strumenti di potere, verranno ad esempio usati nei cosiddetti "Oggetti Intelligenti", che oggi sono una minoranza, ma in dieci anni diventeranno la norma. Saranno in mano a grandi organizzazioni, non statali e statali, come l'NSA o i GAFAM odierni. Saranno usate anche come armi, per combattere guerre multidimensionali in cui uno dei nuovi piani di battaglia sarà la cultura dell'umanità. Non semplice propaganda, ma produzione di informazione verosimile ma falsa, errata, viziata ad arte in modo che sia funzionale a uno scopo.

Che ne sarà della scienza, dove si avanza per ipotesi e verifiche, dubbi e controlli, e dove solo la condivisione e il confronto su conoscenze pregresse ed esatte permettono di progredire? Oggi lo scienziato si nutre di libri e pubblicazioni, e già il fatto che siano costose e difficili da reperire, o addirittura segrete e protette dal copyright, limita moltissimo il lavoro di chi produce davvero cultura.

Quando un domani la base stessa della cultura sarà inquinata da cultura "finta" prodotta da finte "Intelligenze Artificiali" e usata per scopi di potere, cosa succederà? Perché a questo verranno adibiti questi programmi presentati come abili chatbot o supporti decisionali. E la cultura stessa, l'Infosfera sarà in grado di sopravvivere a una "guerra" combattuta con questi mezzi? O sarà distrutta da un fenomeno equivalente alla distruzione dell'Ecosfera provocata dalla tanto temuta guerra termonucleare globale, catastrofe che invece per fortuna non ha avuto luogo?

Concludendo: oggi Cassandra non ha fatto il suo abituale lavoro; queste sono solo utili domande per voi, non profezie. State attenti, ed esercitate il senso critico tutte le volte che sentite la Parola, per evitare che scatti il Sortilegio. Almeno in questo, cercate di vivere responsabilmente.

Li sentite i risolini che provengono dalla vostra alexa, dal vostro cellulare, dalla vostra domotica, dalla vostra autovettura. Io li avevo sentiti venire da dentro un cavallo di legno, ma nessuno mi diede retta. Sapete bene come è andata a finire. Stateve accuorti!

|

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato con Zeus News

ti consigliamo di iscriverti alla Newsletter gratuita.

Inoltre puoi consigliare l'articolo utilizzando uno dei pulsanti qui

sotto, inserire un commento

(anche anonimo)

o segnalare un refuso.

© RIPRODUZIONE RISERVATA |

|

|

Scrivere a Cassandra - Twitter - Mastodon

Videorubrica "Quattro chiacchiere con Cassandra"

Lo Slog (Static Blog) di Cassandra

L'archivio di Cassandra: scuola, formazione e pensiero

Commenti all'articolo (ultimi 5 di 15)

31-3-2023 18:32

5-3-2023 20:47

24-2-2023 17:39

Inserisci un commento - anche se NON sei registrato

|

|

||

|

- Al caffe' dell'Olimpo:

[GIOCO] Il Bersaglio - Motori di ricerca:

I motori di ricerca & la privacy - Tablet e smartphone:

Utilizzo smartphone - Internet - generale:

Come interagite con la IA? - Aiuto per i forum / La Posta di Zeus / Regolamento:

Avvisi risposte e notifiche MP non mi arrivano - Altra ferraglia stand-alone:

Android TV e smart TV - Sicurezza:

Abbonamento ad antivirus con prova gratuita - Programmazione:

Evoluzione di carriera: da Sviluppatore IBM i a

PM/Tech Lead - Windows 11, 10:

Comparsa di un Disco Locale sconosciuto - Linux:

Infloww su linux, si può?

Gladiator