Due parole sul blocco di ChatGPT

- Articolo multipagina2 / 2

[ZEUS News - www.zeusnews.it - 11-04-2023]

Questo è un articolo su più pagine: ti invitiamo a leggere la pagina iniziale

Il Garante Privacy limita ChatGPT

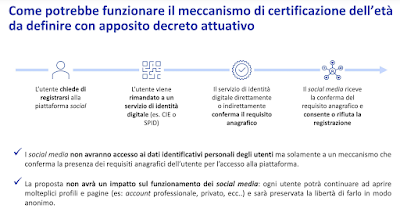

Spendo due parole a proposito di quello che molti hanno definito impropriamente il blocco di ChatGPT in Italia voluto dal Garante per la Privacy nazionale. In realtà [come nota per esempio Cybersecurity360.it] è stata OpenAI, l'azienda che gestisce ChatGPT, ad autosospendere il servizio per gli utenti italiani in attesa di regolarizzare la propria posizione legale, visto che il Garante italiano le ha segnalato che non rispettava il regolamento europeo sulla privacy e sul trattamento dei dati, per esempio dando libero accesso anche ai minori di 13 anni.

[Nota: anche il Canada ha avviato un'istruttoria; Germania, Francia e Irlanda si appresterebbero a seguire l'esempio del Garante italiano, secondo La Regione/Ats/Reuters]

È molto probabile che questa autosospensione cessi presto, quando OpenAI si metterà in regola. Però nel frattempo molti utenti si sono indignati e si sono affrettati a tentare di aggirare questa autosospensione, usando software di VPN e simili per far sembrare di non essere in Italia.

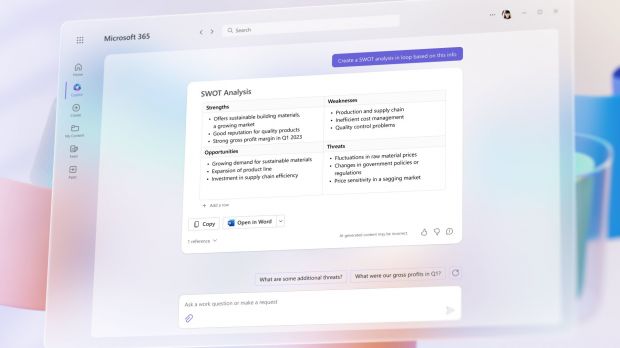

Tuttavia la questione della privacy dei dati degli utenti, con questi software di intelligenza artificiale, è seria e fondata: lo sanno bene i dipendenti di Samsung, per esempio, che hanno subìto una fuga di dati sensibili su progetti industriali perché hanno immesso in ChatGPT il codice sorgente dei loro software aziendali per farselo controllare. Ma OpenAI avvisa che quello che si immette può essere letto dai dipendenti dell'azienda [dalle sue FAQ: "Your conversations may be reviewed by our AI trainers to improve our systems"; informativa sulla privacy].

Se immaginate un medico che carica in ChatGPT un referto per farselo riassumere o analizzare, con nomi e cognomi, o un ragazzo che si rivolge a ChatGPT per avere risposte su argomenti delicati come la sessualità e i rapporti interpersonali pensando che sia uno spazio privato, forse le motivazioni del Garante diventano più chiare. Anche perché è già stato segnalato il primo caso documentato di una persona incoraggiata a suicidarsi da un servizio di chat basato sull'intelligenza artificiale.

ChatGPT e simili sono degli strumenti utili, ma è essenziale conoscerne i limiti e il reale funzionamento: non sono veramente intelligenti, danno facilmente suggerimenti falsi o pericolosi, e quello che vi immettete non resta segreto.

|

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato con Zeus News

ti consigliamo di iscriverti alla Newsletter gratuita.

Inoltre puoi consigliare l'articolo utilizzando uno dei pulsanti qui

sotto, inserire un commento

(anche anonimo)

o segnalare un refuso.

|

|

|

(C) by Paolo Attivissimo - www.attivissimo.net.

Distribuzione libera, purché sia inclusa la presente dicitura.

Stack Overflow contro la IA: banditi i contenuti generati da ChatGPT

Commenti all'articolo (ultimi 5 di 8)

15-4-2023 11:19

15-4-2023 11:15

14-4-2023 21:17

12-4-2023 18:18

12-4-2023 07:13

Inserisci un commento - anche se NON sei registrato

|

|

||

|

- Al caffe' dell'Olimpo:

[GIOCO] Associazioni di idee - Motori di ricerca:

I motori di ricerca & la privacy - Tablet e smartphone:

Utilizzo smartphone - Internet - generale:

Come interagite con la IA? - Aiuto per i forum / La Posta di Zeus / Regolamento:

Avvisi risposte e notifiche MP non mi arrivano - Altra ferraglia stand-alone:

Android TV e smart TV - Sicurezza:

Abbonamento ad antivirus con prova gratuita - Programmazione:

Evoluzione di carriera: da Sviluppatore IBM i a

PM/Tech Lead - Windows 11, 10:

Comparsa di un Disco Locale sconosciuto - Linux:

Infloww su linux, si può?

Gladiator