L'IA? È pericolosa come una guerra nucleare

Può causare l'estinzione del genere umano, almeno secondo una nuova petizione firmata da scienziati e personaggi noti.

[ZEUS News - www.zeusnews.it - 02-06-2023]

«Ridurre il rischio di estinzione a causa della IA dovrebbe essere una priorità mondiale, al pari di altri rischi che minacciano l'intera società, come le pandemie e la guerra nucleare».

A lanciare questo grido d'allarme non è qualche profeta apocalittico né si tratta esattamente delle stesse persone che già alla fine di marzo parlavano dei rischi derivanti dall'Intelligenza Artificiale.

Scienziati e «altre figure importanti» hanno infatti firmato una nuova petizione affinché si apra un confronto franco sui pericoli - ritenuti molto reali e concreti dello sviluppo della IA e crei «una conoscenza comune derivata dal crescente numero di esperti e personaggi pubblici che prendono sul serio alcuni dei rischi più gravi dell'IA avanzata».

Una scorsa all'elenco dei firmatari porta a scoperte interessanti: si notano infatti i nomi di persone come Sam Altman, CEO di OpenAI (l'azienda che ha creato ChatGPT) e Demis Hassabis, CEO di DeepMind, azienda del gruppo Alphabet (lo stesso di Google).

Ancora, vi si trovano Yoshua Bengio (che aveva già firmato) e Geoffrey Hinton la petizione di marzo, vincitori del Premio Turing e da molti considerati i "padrini" della moderna Intelligenza Artificiale.

Che lo sviluppo incontrollato della IA ponga dei seri quesiti a cui è necessario rispondere non dovrebbe essere un mistero per nessuno: anche senza aspettarsi che una IA sviluppi autocoscienza, già il semplice fatto che essa possa essere usata per creare falsi estremamente convincenti, per esempio dando vita a duplicati virtuali di politici o personaggi noti quasi indistinguibili dall'originale, dovrebbe spingere a riflettere.

Sono peraltro otto i rischi maggiori individuati dal Center for AI Safety, che ospita la petizione.

Si va dalla possibilità di usare le IA come "armi" - ai fini di destabilizzazione politica, per esempio - alla diffusione di disinformazione, ma ci sono anche rischi più sottili come «l'indebolimento»: la possibilità che un affidamento sempre più completo alle macchine finisca per creare una dipendenza dalla quale sarebbe molto difficile riuscire a evadere a causa della perdita di competenze chiave, un po' come nel film Wall-E.

|

Se questo articolo ti è piaciuto e vuoi rimanere sempre informato con Zeus News

ti consigliamo di iscriverti alla Newsletter gratuita.

Inoltre puoi consigliare l'articolo utilizzando uno dei pulsanti qui

sotto, inserire un commento

(anche anonimo)

o segnalare un refuso.

© RIPRODUZIONE RISERVATA |

|

Intelligenza Artificiale: il sortilegio

L'intelligenza artificiale oltre i suoi limiti

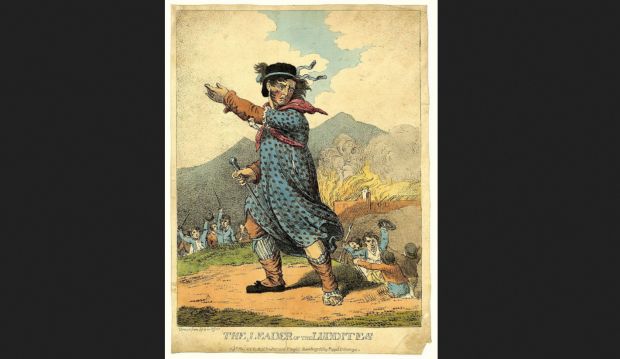

Neo Luddismo

IA: ragionare usando i dati

Cassandra Crossing/ Congiuntivo, virgola e bit

Cassandra crossing/ Overload informativo, overload sociale

Riflessioni di Cassandra/ Scrittore, giornalista, blogger o influencer?

Cassandra Crossing/ Il quarto Cavaliere

Cassandra Crossing/ Storie di aerei caduti e del loro software

Cassandra Crossing/ Extended Play

Cassandra Crossing/ L'insostenibile inaffidabilità delle infrastrutture

Spiccioli di Cassandra/ La Tv nuova

Cassandra Crossing/ Bandersnatch

Lampi di Cassandra / Una cartolina da Saturno

Commenti all'articolo (ultimi 5 di 10)

29-7-2023 13:40

23-7-2023 13:16

13-6-2023 22:11

Inserisci un commento - anche se NON sei registrato

|

|

||

|

- Al caffe' dell'Olimpo:

[GIOCO] Il Bersaglio - Internet - generale:

Girls In Your Town - No Selfie - Anonymous Casual

Dating - Motori di ricerca:

I motori di ricerca & la privacy - Tablet e smartphone:

Utilizzo smartphone - Aiuto per i forum / La Posta di Zeus / Regolamento:

Avvisi risposte e notifiche MP non mi arrivano - Altra ferraglia stand-alone:

Android TV e smart TV - Sicurezza:

Abbonamento ad antivirus con prova gratuita - Programmazione:

Evoluzione di carriera: da Sviluppatore IBM i a

PM/Tech Lead - Windows 11, 10:

Comparsa di un Disco Locale sconosciuto - Linux:

Infloww su linux, si può?

Gladiator